揭秘:英伟达H100最强替代者

来源:半导体行业观察 发布时间:2023-11-13 15:28:16 阅读量:877

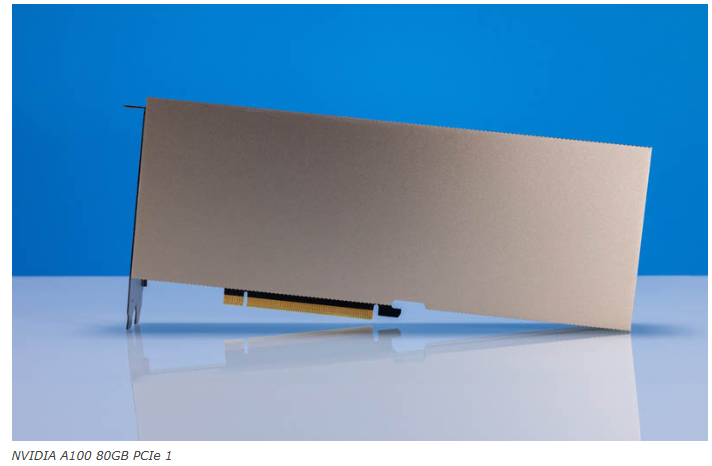

在撰写本文时,NVIDIA H100 80GB PCIe 在 CDW 等在线零售商处的售价为 3.2 万美元,并且缺货了大约六个月。可以理解的是,NVIDIA 的高端(几乎)万能 GPU 的价格非常高,需求也是如此。NVIDIA 为许多人工智能用户和那些在企业中运行混合工作负载的用户提供了一种替代方案,但这种方案并不引人注目,但这是非常好的。NVIDIA L40S 是面向图形的 L40 的变体,本文一起深入了解。

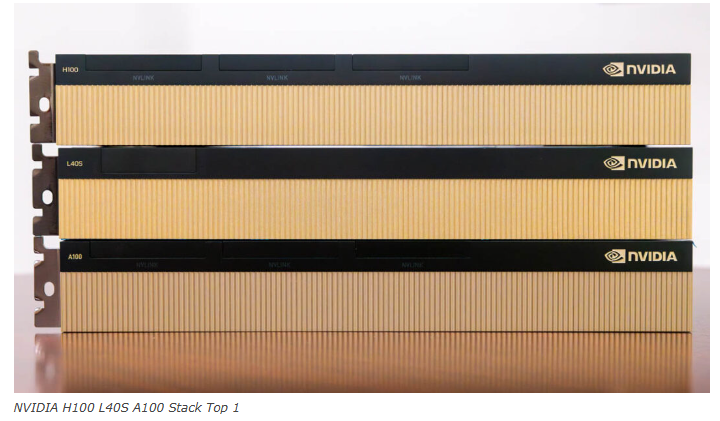

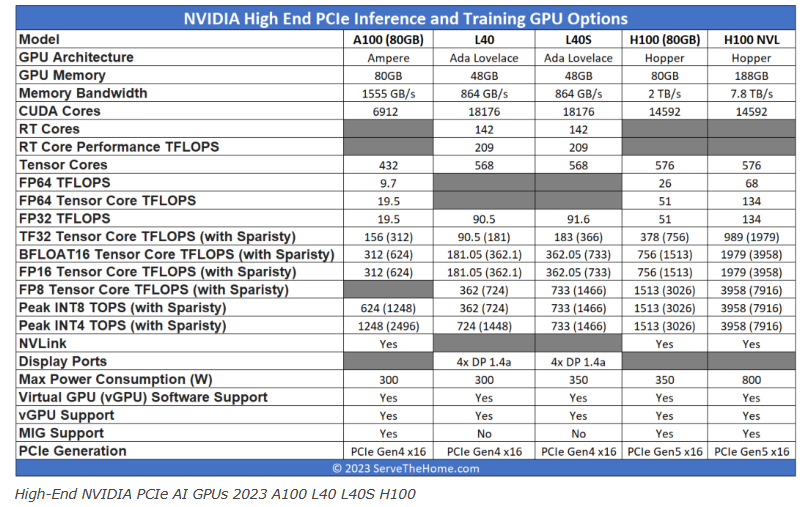

NVIDIA A100、NVIDIA L40S 和 NVIDIA H100

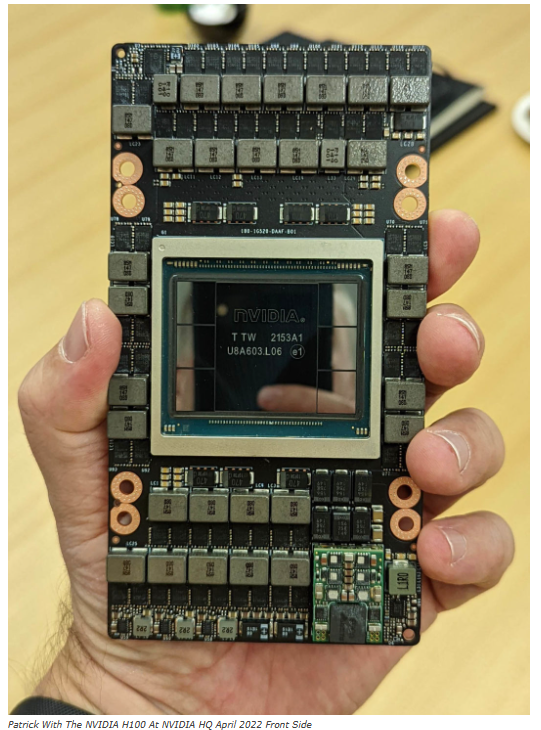

首先,我们首先要说的是,如果您现在想要训练基础模型(例如 ChatGPT),那么 NVIDIA H100 80GB SXM5 仍然是首选 GPU。一旦基础模型经过训练,通常可以在成本和功耗显着降低的部件上根据特定领域的数据或推理来定制模型。

目前,用于高端推理的 GPU 主要有三种:NVIDIA A100、NVIDIA H100 和新的 NVIDIA L40S。我们将跳过NVIDIA L4 24GB,因为它更像是低端推理卡。

在撰写本文时,NVIDIA H100 80GB PCIe 在 CDW 等在线零售商处的售价为 3.2 万美元,并且缺货了大约六个月。可以理解的是,NVIDIA 的高端(几乎)万能 GPU 的价格非常高,需求也是如此。NVIDIA 为许多人工智能用户和那些在企业中运行混合工作负载的用户提供了一种替代方案,但这种方案并不引人注目,但这是非常好的。NVIDIA L40S 是面向图形的 L40 的变体,本文一起深入了解。

NVIDIA A100、NVIDIA L40S 和 NVIDIA H100

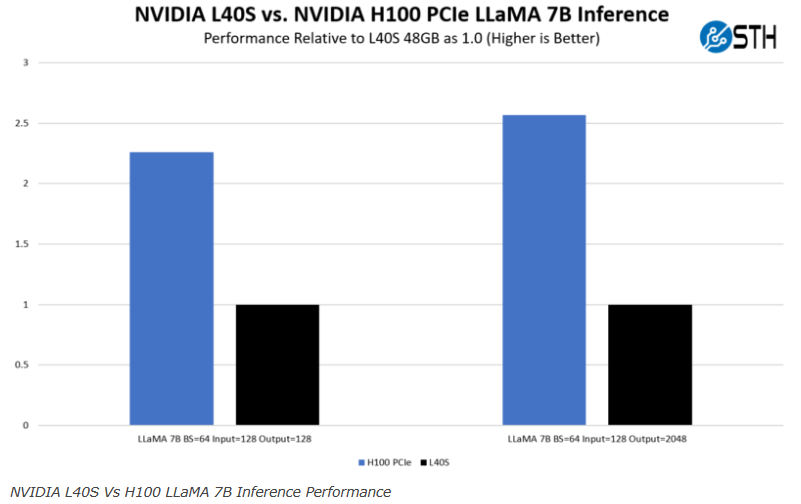

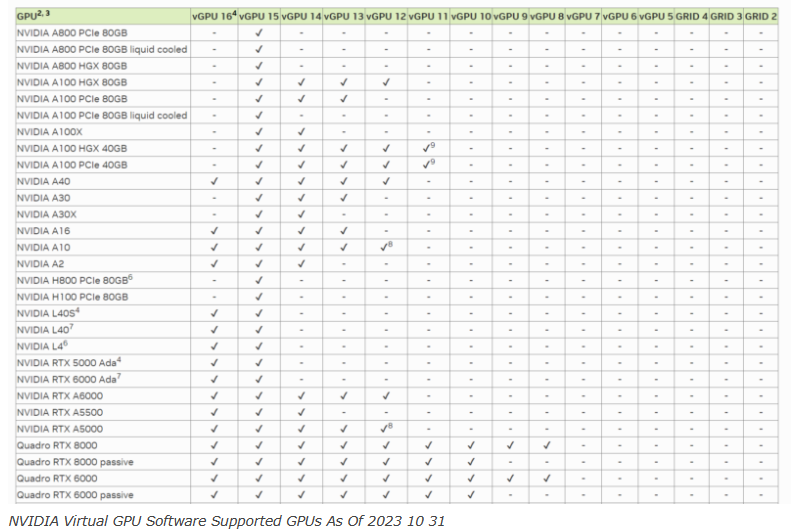

NVIDIA L40S 与 H100 的其他考虑因素

最后的话